2023年国际人工智能联合会议(International Joint Conference on Artificial Intelligence, 简称为IJCAI)录用结果公布。IJCAI是人工智能领域中最主要的学术会议之一,也是中国计算机学会(CCF)推荐的A类国际学术会议之一。本实验室姜旭浩、凌宇为一作完成的2篇论文《Multi-Modality Deep Network for JPEG Artifacts Reduction》、《Learning Survival Distribution with Implicit Survival Function》被录用。

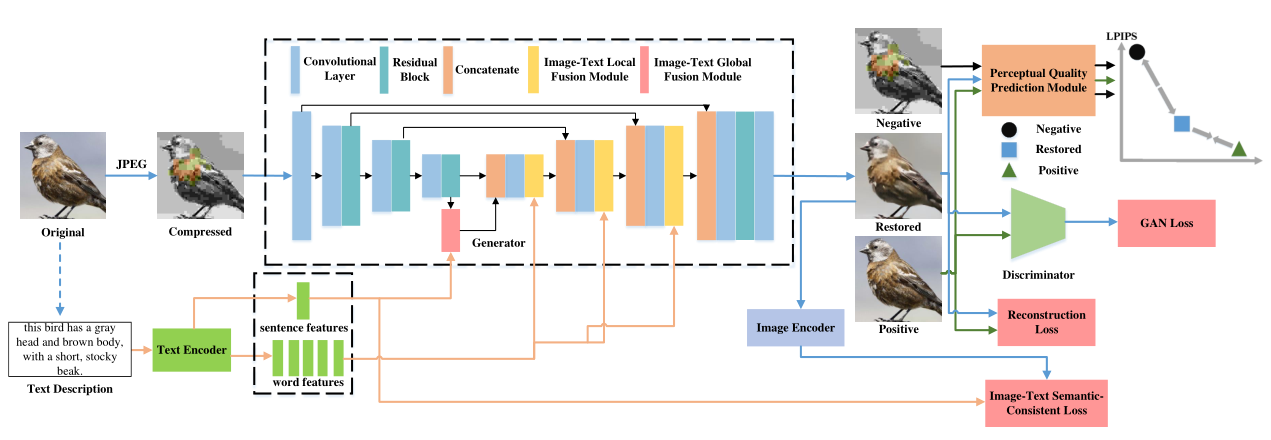

图1算法框架图

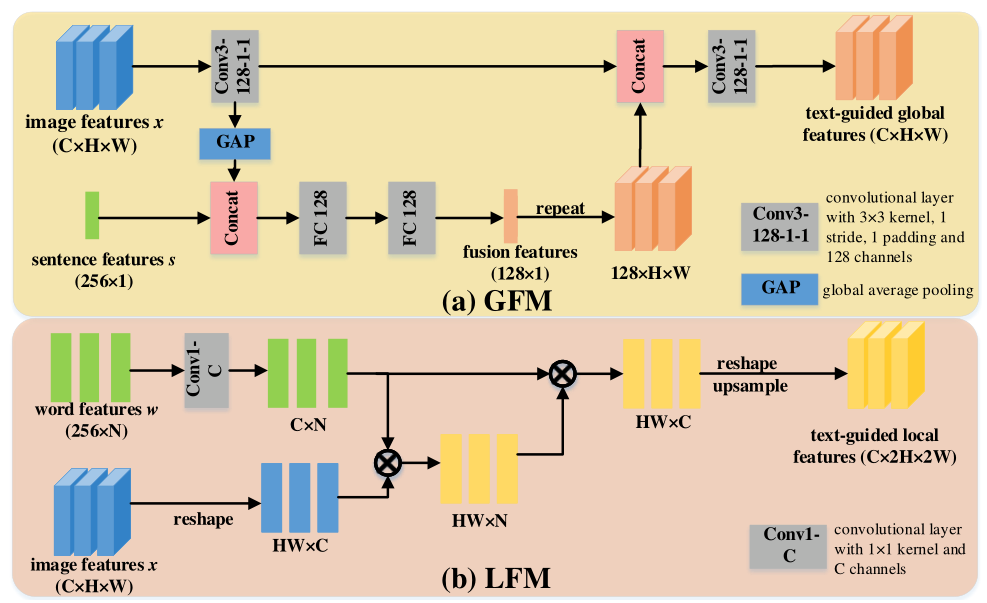

图2多模态融合模块

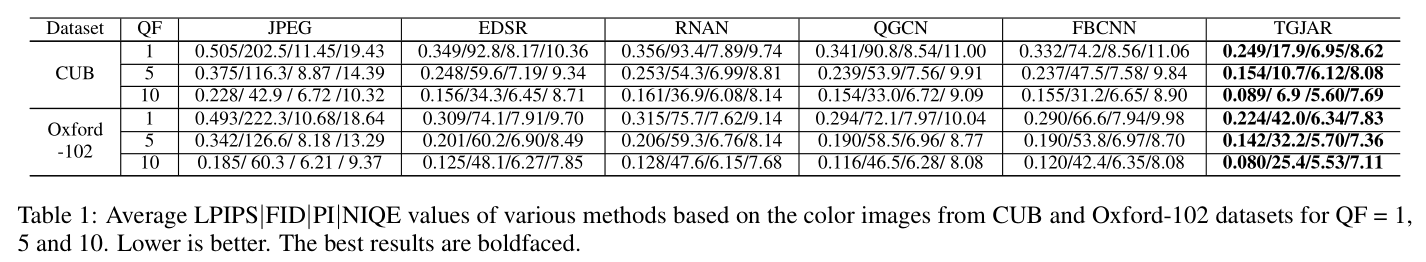

图3定量结果对比

图4定性结果对比

图像JPEG压缩噪声去除一直是一个基础且重要的研究方向,其可以有效提升压缩图像的感知质量并进一步提升下游视觉任务的性能。然而,当传输带宽较窄时,图像被严重压缩,例如压缩因子被设置为1。在这种情形下,现有算法无法实现高质量的重建因为图像语义信息严重缺失。因此,提出一种面向低码率的压缩图像增强算法是十分有意义的研究。本文提出了一个新颖的文本指导图像压缩噪声去除框架(图1),其利用文本的语义信息作为先验信息来指导图像的增强。我们设计了两个多模态融合模块(图2)分别从全局和局部角度融合图像特征和文本语义特征。全局融合模块通过分别提取图像和文本的全局特征进行融合来去除噪声,而局部融合模块利用注意力机制来捕获图像和文本的相关性来增强图像的语义信息。我们还设计了一个基于LPIPS模型的对比损失,以产生视觉上令人愉悦的结果。大量实验结果表明,相比于现有的图像压缩噪声去除算法,提出的算法在多项感知指标上均取得大幅提升(图3)。此外,提出算法生成的结果在主观视觉上明显优于其它算法(图4)。

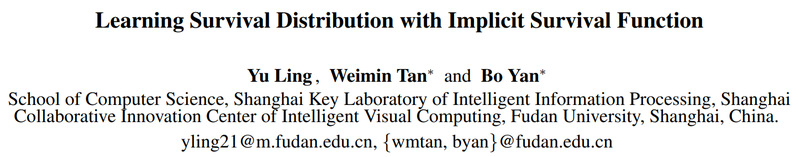

图1方法图示

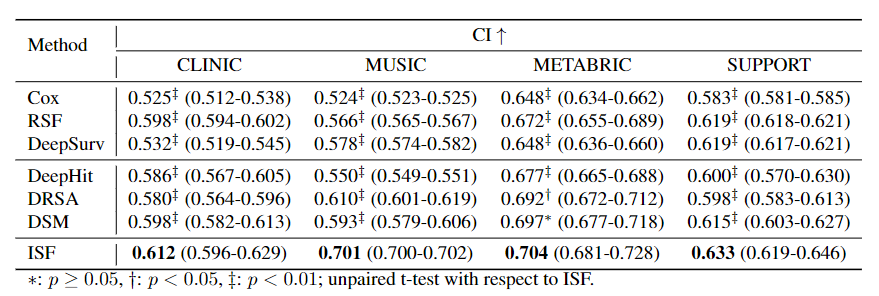

图2在四个公开数据集上的实验结果

生存分析旨在对样本与某个时间的发生之间的关系进行建模,是一个经典的统计问题。在实际场景中,往往存在大量样本存在“删失”的情况,如观测早于事件发生的时间结束。此时,我们只能获知最后的观测时间,而不能确定准确的事件发生时间。因此,在生存分析中对删失样本的建模也非常重要。已有的方法对生产分布的建模往往基于对分布的假设或者只能通过离散的时间点预测固定数量的概率。我们提出使用隐式神经表示的方式直接对生存分布建模,即建立模型H(E(x)+PE(t))(图1)。其中,我们引入基于三角函数的位置编码PE对连续的时间进行编码,并且利用多层感知机建立编码器E与回归器H。虽然模型能够直接获得条件风险率,但是基于多层感知机的隐式神经表示难以得出累积密度函数的解析解。因此,我们通过数值积分对累积密度函数进行近似,并借此构建能够适应于任意删失类型的损失函数。根据实验结果,我们的方法在数个公开数据集上均取得了最好的性能图(2)。